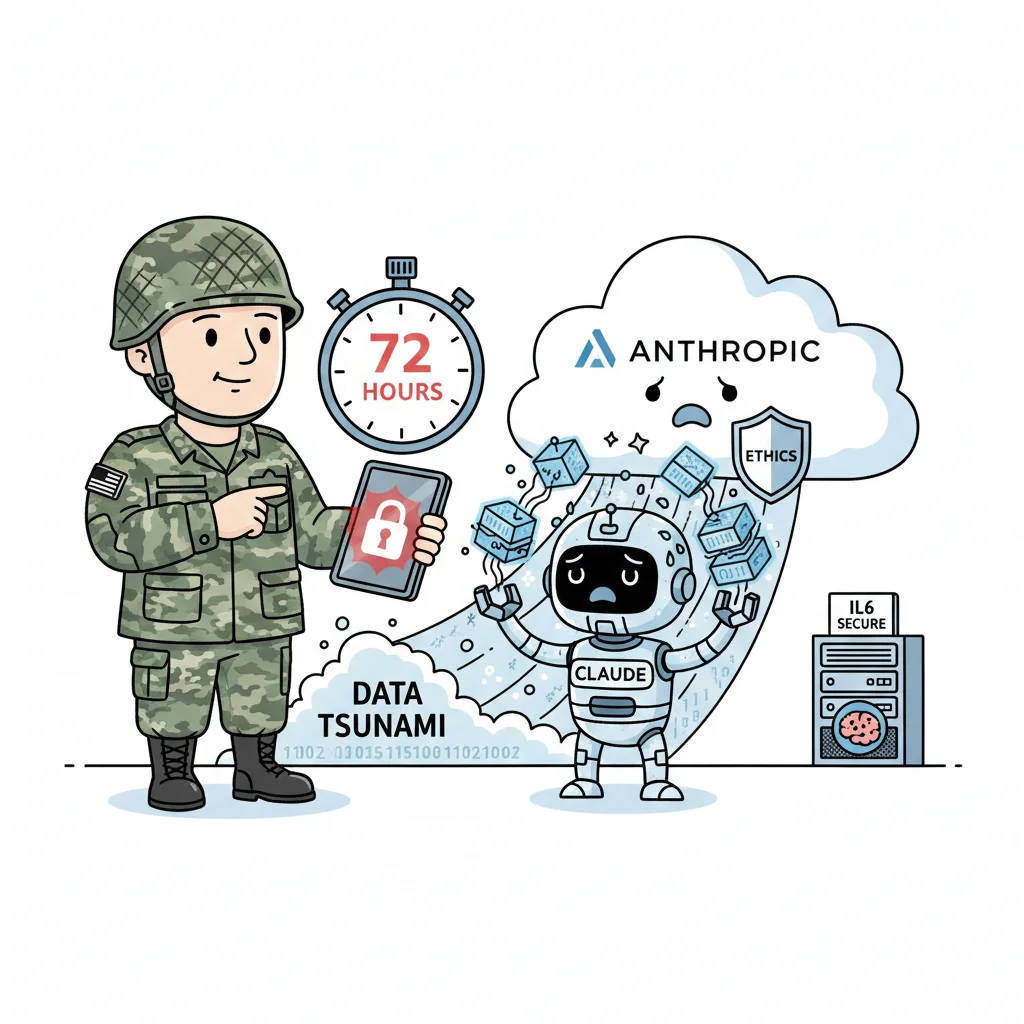

IA militaire : le Pentagone exige un accès illimité aux modèles Claude d'Anthropic sous 72 heures

Le Département de la Défense américain accentue sa pression sur Anthropic. Invoquant la sécurité nationale, le Pentagone réclame un accès total et permanent à ses modèles de langage pour des tests intensifs, marquant un tournant décisif dans l'intégration des LLM civils au sein de l'appareil militaire.

Une sommation stratégique pour le "Red Teaming" à grande échelle

La demande du Pentagone s'inscrit dans un cadre contractuel strict. L'objectif est d'obtenir un accès "unfettered" (sans entraves) aux interfaces de programmation (API) et aux poids des modèles (weights) pour mener des opérations de Red Teaming. Techniquement, il s'agit de soumettre les modèles Claude (notamment les versions 3.5 Sonnet et Opus) à des requêtes extrêmes pour identifier des vulnérabilités cybernétiques ou des capacités de génération de code malveillant.

Le délai de 72 heures imposé pour la mise à disposition de ces ressources souligne l'urgence opérationnelle du DoD. Ce dernier souhaite évaluer la robustesse des garde-fous (safety guardrails) et la capacité du modèle à traiter des données classifiées sans fuite d'information via les mécanismes d'attention ou le cache de contexte.

Intégration technique et environnements sécurisés (IL6)

Au-delà du simple accès, l'enjeu réside dans le déploiement de ces modèles sur des infrastructures souveraines. Le Pentagone vise une intégration au sein d'environnements Impact Level 6 (IL6), le plus haut niveau de sécurité pour les données non classifiées mais sensibles, nécessitant une isolation complète du réseau internet public (air-gap).

Cette exigence implique pour Anthropic de fournir des versions de ses modèles capables de fonctionner en local ou sur le cloud gouvernemental (GovCloud), sans communication avec les serveurs centraux de l'entreprise. Techniquement, cela nécessite une optimisation de l'inférence pour des architectures matérielles spécifiques et une transparence totale sur les jeux de données d'entraînement afin d'écarter tout risque de "backdoor" ou de biais cognitif induit par des acteurs étrangers.

Vers une militarisation de l'IA constitutionnelle ?

Anthropic s'est distingué par son approche de l'IA constitutionnelle, une méthode où l'IA est entraînée à respecter une liste de principes éthiques. Le Pentagone, en exigeant un accès illimité, cherche à vérifier si ces principes sont compatibles avec des scénarios tactiques. Le risque pour Anthropic est de voir sa technologie de sécurité détournée pour optimiser des systèmes de décision sur le champ de bataille, une perspective qui heurte frontalement la mission originelle de "sécurité et d'innocuité" de l'entreprise.

Avis de la Rédac

Il est savoureux de constater que même pour l'armée la plus puissante du monde, attendre plus de trois jours pour obtenir un "prompt" illimité est devenu insupportable. Anthropic, qui a bâti sa réputation sur la prudence et l'éthique, se retrouve désormais dans la position inconfortable du fournisseur de munitions numériques. On attend avec impatience de voir comment la "Constitution" de l'IA gérera un ordre de mission du Pentagone : avec une fin de non-recevoir polie ou une mise à jour silencieuse des règles d'engagement ?

📰 Source : numerama.com

🤖 Cet article a été rédigé avec l'assistance de l'intelligence artificielle à partir de sources vérifiées par la rédaction. En savoir plus