Google AI Overviews : des faux numéros de SAV exploitent les résumés IA

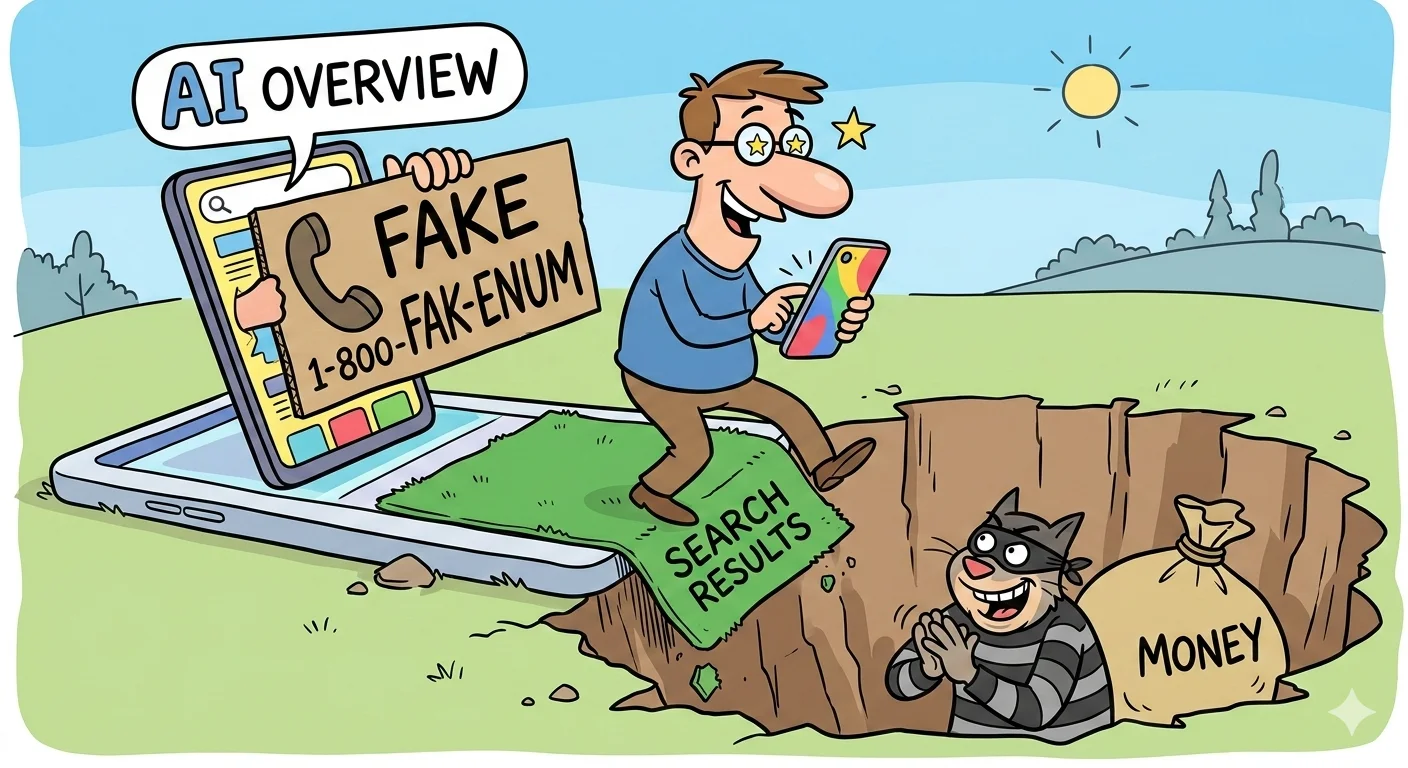

Les résumés IA de Google affichent parfois des numéros de SAV frauduleux, exploités par des arnaqueurs pour piéger les utilisateurs. Une faille critique à surveiller.

Une faille critique dans les AI Overviews de Google

Les AI Overviews, ces résumés générés par intelligence artificielle en tête des résultats de recherche Google, deviennent un vecteur d’arnaques. Des numéros de service client frauduleux s’y glissent, exploitant la confiance des utilisateurs. Disponible dans plus de 200 pays, cette fonctionnalité pose des risques sécuritaires majeurs, notamment pour les transactions financières.

Mécanisme de l’arnaque : comment les faux numéros infiltrent les résultats

Les arnaqueurs exploitent la génération automatique de contenu par IA pour insérer des numéros de contact frauduleux. Par exemple, un utilisateur cherchant le SAV de Royal Caribbean a été redirigé vers un faux numéro. L’escroc, se faisant passer pour un employé, a facturé 768 $ pour un service gratuit. Cette technique repose sur la crédibilité apparente des résultats Google, souvent perçus comme vérifiés.

Architecture technique : comment Google génère les AI Overviews

Les AI Overviews s’appuient sur des modèles de langage (LLM) entraînés sur des données publiques. Google utilise des algorithmes de ranking pour prioriser les réponses, mais l’absence de vérification humaine systématique laisse des failles. Les requêtes sont traitées via des API internes, avec des filtres anti-spam limités face aux manipulations ciblées.

Impact sur la sécurité des utilisateurs

Cette faille expose les utilisateurs à des fraudes financières, des vols de données et des usurpations d’identité. Les escrocs profitent de l’urgence (ex : problèmes techniques) pour inciter à des paiements immédiats. Google n’a pas encore déployé cette fonctionnalité en France, mais les risques sont réels ailleurs, notamment aux États-Unis et en Europe.

Limites des solutions actuelles

Google propose des rapports d’arnaques via son formulaire dédié, mais le processus est lent. Les filtres automatisés peinent à détecter les numéros frauduleux, car les escrocs changent fréquemment leurs tactiques. Une vérification manuelle des résultats sensibles (SAV, transactions) serait nécessaire, mais coûteuse à mettre en œuvre.

Comparaison avec d’autres services IA

ChatGPT, autre outil de génération de contenu, est aussi concerné. Les deux plateformes partagent des vulnérabilités similaires : absence de validation en temps réel et dépendance à des données non vérifiées. Les utilisateurs doivent croiser les sources avant d’agir sur des informations fournies par ces outils.

Recommandations pour les utilisateurs

Pour éviter les pièges : vérifier les numéros sur les sites officiels, utiliser des canaux sécurisés (ex : applications vérifiées) et signaler les anomalies. Google pourrait améliorer la transparence en affichant l’origine des données (ex : « généré par IA, non vérifié »).