Godot en péril ? Le cri d'alarme du moteur de jeu face au "spam" de code généré par l'IA

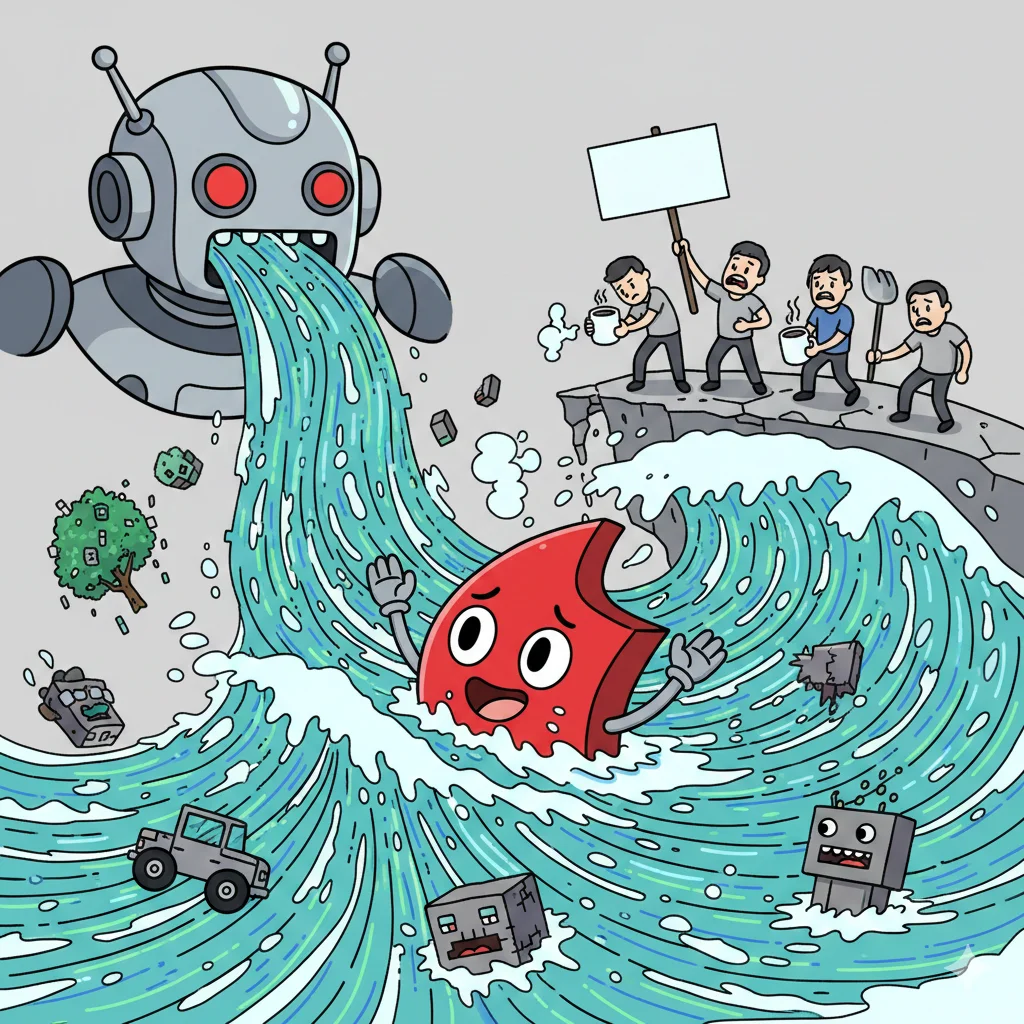

Le moteur de jeu open source Godot fait face à une crise inédite. Submergés par des contributions de piètre qualité générées par l'IA, les mainteneurs tirent la sonnette d'alarme : la survie du projet et la santé mentale des bénévoles sont en jeu. Un défi technique et humain majeur.

L'IA : une fausse bonne idée pour l'Open Source ?

L'essor des outils comme ChatGPT ou GitHub Copilot facilite la rédaction de code, mais pose un problème critique pour les projets collaboratifs. Godot reçoit une vague massive de "Pull Requests" (propositions de modifications) dont le code est souvent syntaxiquement correct, mais logiquement absurde ou inadapté à l'architecture complexe du moteur.

L'épuisement des mainteneurs

Le cœur du problème ne réside pas seulement dans la qualité du code, mais dans le temps nécessaire pour l'examiner. Chaque soumission doit être testée et vérifiée par des humains. Face à des milliers de lignes générées en quelques secondes par une IA, les contributeurs bénévoles saturent. "Je ne sais pas combien de temps nous pourrons tenir", confie l'un des responsables, soulignant un risque réel de "burn-out" collectif.

Vers une restriction des contributions ?

Pour protéger l'intégrité du moteur, la communauté Godot réfléchit à des mesures drastiques. Cela pourrait passer par :

L'interdiction pure et simple du code non vérifié par son auteur.

L'utilisation de filtres plus stricts à l'entrée.

Une sensibilisation accrue sur le fait que l'IA doit être une aide à la compréhension, et non un remplaçant de la réflexion humaine.

Un enjeu qui dépasse Godot

Cette situation est un signal d'alarme pour l'ensemble de l'écosystème logiciel libre. Si les outils d'IA permettent de produire du volume, ils ne garantissent pas la qualité. Sans une régulation de ces flux, les projets open source les plus populaires pourraient s'effondrer sous le poids d'une "pollution numérique" automatisée.